In quali mani sono i dati utilizzati per il training dell’AI?

Chi sono i possessori dei dati che vengono utilizzati per il training dell’AI?

1.250 persone tra imprenditori (tra cui Elon Musk), professori, filosofi, esperti di varia natura hanno già firmato una lettera aperta – cui volendo possiamo partecipare tutti – per fermare temporaneamente le ricerche e le sperimentazioni sull’intelligenza artificiale. “I sistemi di intelligenza artificiale dotati di intelligenza competitiva con quella umana possono comportare rischi profondi per la società e l’umanità” è l’incipit della lettera che vorrebbe all’improvviso gettare un’ombra su una tecnologia che ormai già domina il mondo e sui cui gli stessi firmatari hanno costruito imperi finanziari. Come tutte le tecnologie la vera discriminante è l’uso che se ne fa. Non essendo dotate di coscienza né etica, ma essendo solo un complesso agglomerato di formule matematiche, sta a chi le utilizza commercialmente stabilire limiti e regole. Nicola Grandis, Ceo di Asc27, azienda specializzata in AI, parla di alcuni aspetti meno noti e meno discussi di cui realmente dovremmo preoccuparci, quali la privacy e il copyright dei dati che l’intelligenza artificiale usa quando fa web scraping.

È di ieri la notizia che il garante della privacy ha avviato una istruttoria sull’uso dei dati personali da parte di ChatGpt. Lei che ne pensa?

L’AI trae la sua forza dai dati che le vengono forniti. Da questi dati l’AI impara, migliora e crea modelli per analizzare il mondo. E sempre su questi dati, come insegnano le recenti vicende di cronaca, che riportano notizie di class-actions e altre cause legali inoltrate da persone comuni e aziende verso le Giant-Tech americane, si innescano diversi problemi relativi alla proprietà intellettuale degli stessi. Modelli matematici che richiedono basi dati colossali per il loro allenamento, non possono che far leva su dati esistenti, ma a quale prezzo? Chi sono i possessori dei dati che vengono utilizzati per il training? Le cose si complicano quando miliardi di informazioni scomposte vanno a costruire il modello AI di un oggetto nuovo come ChatGPT, Dall-E, LLama, Stable Diffusion o altri.

Come mai fino ad oggi non si è posto il problema?

Forse per la prima volta nella storia abbiamo a disposizione una tecnologia che impara dal nostro passato e dal lavoro già svolto. Una tecnologia che utilizza le capacità umane di comprensione ed esecuzione per imparare a svolgere compiti nuovi e completamente suoi. Non si tratta di competenze cognitive o intellettuali, quanto piuttosto di esercizi specifici che una singola tecnologia, montata su piastre di silicio, riesce ad eseguire in luogo di eserciti di umani. Prima di eventi di massa come la democratizzazione degli LLM (Large Language Model) non ci siamo mai confrontati con temi di questo tipo, proprio perché non abbiamo mai avuto una tecnologia che apprendesse direttamente dal lavoro degli umani. I concetti di Privacy e di Copyright ci sono noti, ma sempre in un ambito Uomo-Uomo, per la prima volta li dobbiamo osservare dalla prospettiva Uomo-Macchina.

In qualche modo Privacy e Copyright sono anche temi divisivi. Nell’ambito dell’AI, si intersecano con interessi economici, scientifici e investono diverse sfere della struttura sociale…

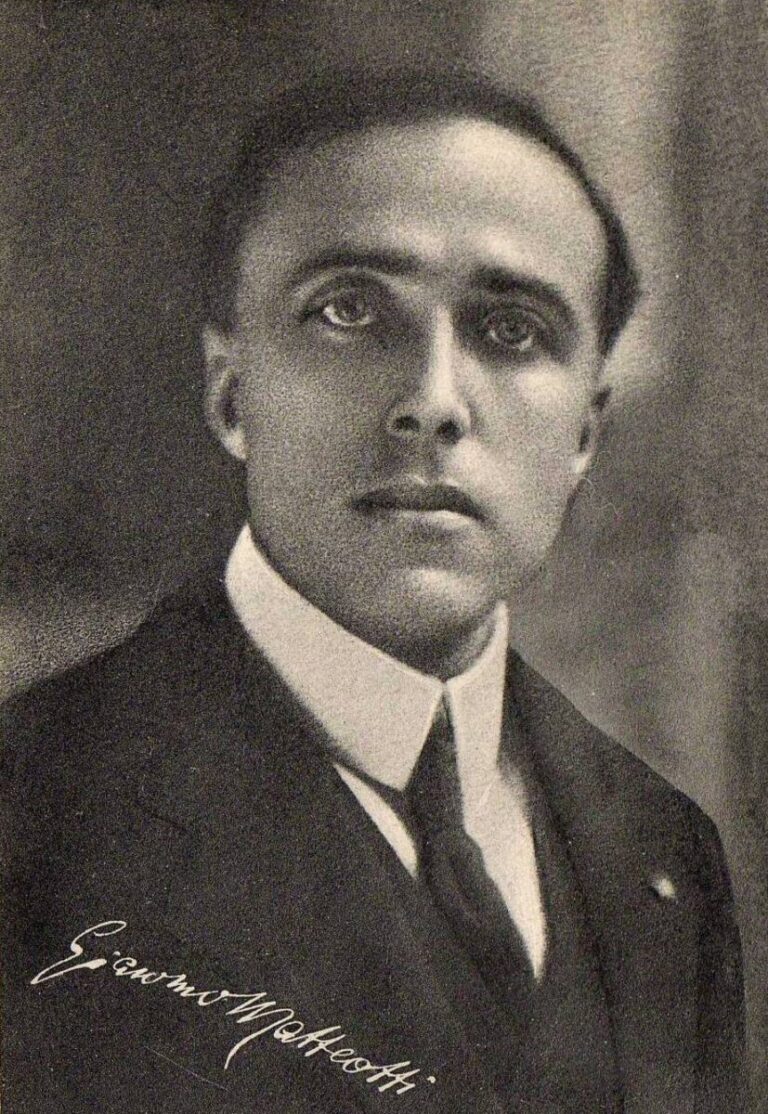

la Privacy nel rapporto Uomo-Macchina è un concetto abbastanza astratto, non si dovrebbe probabilmente parlare di Privacy applicata all’AI, o alla macchina, quanto piuttosto di chi beneficia dei risultati che la macchina produce. In altri termini, se la macchina non ha in sé il concetto di Privacy, non può né applicarlo né eluderlo, è semmai l’uomo o l’azienda che utilizza l’AI che ne può abusare. Per trasposizione, applicando lo stesso ragionamento al concetto di Copyright, non sarà mai la macchina o l’AI a violare i diritti di molti scrittori approfittando dei contenuti che costoro hanno scritto per il proprio training, quanto piuttosto potrebbero essere le aziende che ne beneficeranno a doversi porre la questione. Dunque, un’AI che apprendesse anche da una foto del mio volto e che ne utilizzasse delle porzioni, delle caratteristiche (features come si chiamano in AI), starebbe violando la mia Privacy o generando un problema di Copyright per il suo utilizzatore?

Quali soluzioni si prospettano?

Alcuni gruppi di ricerca stanno lavorando a soluzioni su questi temi, traggono generalmente spunte dalle tecniche di xAI (explainable Artificial Intelligence), tecniche con le quali un modello AI non si limita a fornire delle soluzioni basate sui dati, ma fornisce anche delle indicazioni su come sia pervenuto al risultato offerto. Però, siamo ancora ai primi tornanti verso questa meta in salita.